NVIDIA impulsa la revolución local de la IA: ejecuta modelos avanzados directamente en tu PC con GeForce RTX

En medio de un creciente interés por la privacidad, el control y la reducción de costos en el uso de inteligencia artificial (IA), NVIDIA presenta nuevas herramientas y optimizaciones que permiten ejecutar modelos de lenguaje de gran tamaño (LLMs) directamente en computadoras personales con GPU GeForce RTX. Gracias a los últimos avances en software y hardware, los usuarios ahora pueden disfrutar de un rendimiento ágil y local, sin depender de la nube.

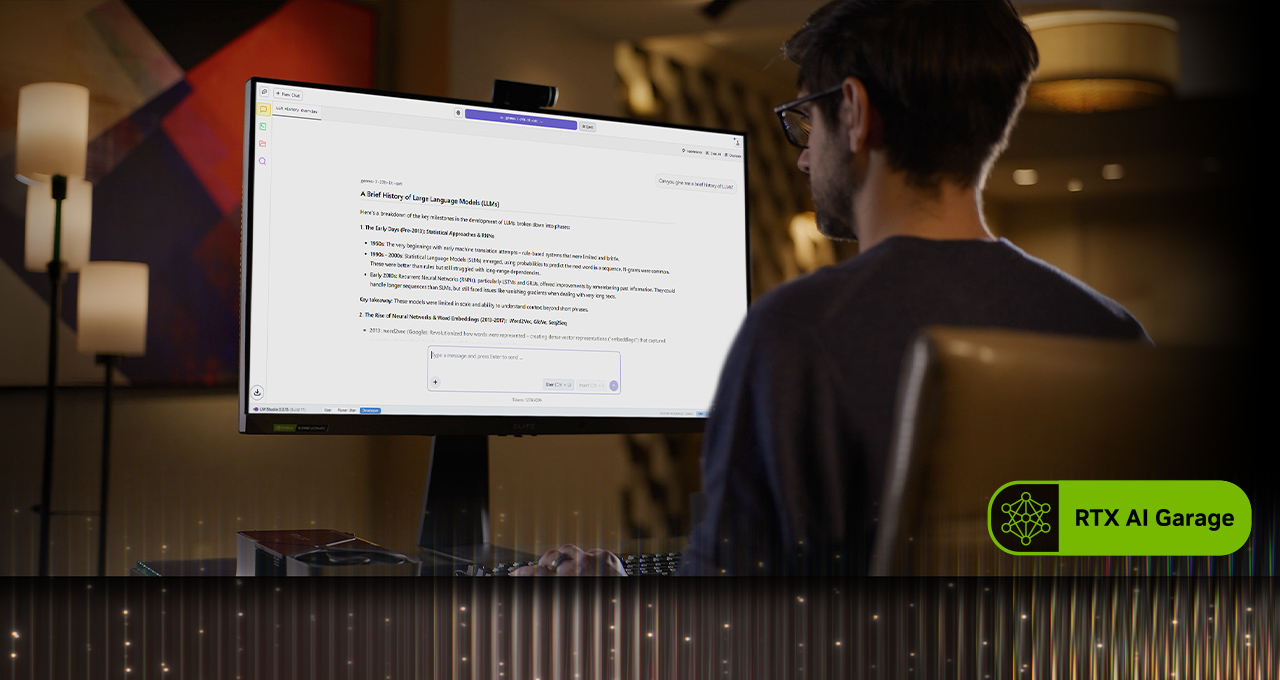

El más reciente RTX AI Garage Blog de NVIDIA explica cómo estudiantes, desarrolladores y entusiastas de la IA pueden comenzar a experimentar hoy con modelos avanzados desde su propio escritorio:

-

Ollama: plataforma de código abierto que simplifica la ejecución e interacción con LLMs. Permite mantener conversaciones naturales, arrastrar y soltar documentos PDF en los prompts, e incluso probar flujos multimodales con texto e imagen.

-

AnythingLLM: una extensión sobre Ollama que convierte cualquier PC en un asistente personal privado. Los usuarios pueden cargar notas o presentaciones para crear tutores inteligentes, cuestionarios y tarjetas de estudio.

-

LM Studio: basado en llama.cpp, ofrece una interfaz intuitiva para explorar docenas de modelos, chatear en tiempo real y montar APIs locales personalizadas.

-

Project G-Assist: herramienta que lleva el control inteligente a nuevas alturas. Con su última actualización, los usuarios pueden utilizar comandos de voz o texto para ajustar configuraciones del sistema, como batería, ventiladores o rendimiento.

Las GPU GeForce RTX han recibido optimizaciones significativas para mejorar la experiencia de inferencia en IA local. Ollama, por ejemplo, obtiene hasta 50% más rendimiento con OpenAI’s gpt-oss-20B y hasta 60% de mejora con modelos Gemma 3, mientras que Llama.cpp y GGML integran soporte mejorado para el modelo NVIDIA Nemotron Nano v2 9B, Flash Attention activado por defecto y una programación de núcleos CUDA más eficiente.

Además, Microsoft lanzó Windows ML con NVIDIA TensorRT, una integración que proporciona hasta un 50% más de rapidez en inferencia y compatibilidad con LLMs, modelos de difusión y otros tipos de IA en Windows 11.

Los usuarios pueden descargar G-Assist v0.1.18 desde la NVIDIA App, que añade nuevos comandos para laptops y respuestas de mayor calidad. Para conocer más sobre las innovaciones y las guías para iniciarse en la IA local, visita el RTX AI Garage Blog de esta semana.